AI 影片生成的重大革命突破!OpenAI 在今天推出的 Sora ,簡單幾個文字想法就可以轉化為生動影片。

不管你是要經典黑白到動畫風格,一切都是可能的。

快來發掘 Sora是什麼,到底厲害在哪吧!

Sora 是什麼?

Sora 是 OpenAI 在 2/15 發布的新影片生成模型,是一個 text-to-video (文字轉影片)模型。

你可以透過簡單的文字指令 (Prompt) 、圖片,生成各種風格的影片,像是黑白、動漫、真實電影感的 HD 1080p影片,目前最長可以達到一分鐘。

Sora 厲害在哪?

Sora 透過過去DALL·E 和 GPT 模型的研究和資料打造而成,所以相較於市面上的 AI 影片生成,Sora 更能精準地生成影片中的文字指令。

當你下一個文字指令時,Sora 還懂得這些人物和物品在真實世界裡是怎麼存在的。

舉例來說,如果你讓它畫一個人跳舞,Sora就知道怎麼畫出這個人跳舞時的正確姿勢。

Sora還能在一個影片裡面換好幾個場景,但是讓這些場景裡的人物和風格都保持一致。

就像我們看電影一樣,故事會從一個場景換到另一個場景,故事也都是連貫的。

人物還是那些人物,準確地保留角色和視覺風格。

聽起來很厲害對吧!文章等等我也會列出三個 Sora 厲害的特色,幫助你更容易理解。

Sora 有什麼缺點?

現在Sora 還在開發中,所以他也可能會無法精準的模擬一些比較複雜的場景,或是一些因果關係。

舉例來說,像是一個人咬了餅乾,但餅乾上面卻沒有咬痕,類似這樣因果關係的辨別錯誤。

另外在時間軸上可能也會辨別錯誤,像是有些隨著時間推移發生的事情,他就不一定可以成功產出。

舉例來說,像是以下這個影片,Sora 沒能將椅子建模成剛性物體,所以你就可以看出他的物理互動有點怪。

三大重點讓你簡單理解 Sora 有哪些特色

在研究過國內外媒體的介紹後,我整理了三大重點,幫助你簡單了解 Sora 的特色,就讓我們繼續看下去吧!

重點一:能理解物理世界存在、運作的方式,並且預測推估他的動作

這有什麼特別的嗎?我用例子來舉例比較好理解:

從 NVIDIA 研究科學家 Jim Fan 的 Tweet 可以看出,他只下一個指令是"兩艘海盜船在一杯咖啡內航行時互相戰鬥的逼真特寫影片"。

你可以看到 Sora 產出影片的方式是建立在理解物件存在、運作的方式上:

- 物件在航行並避開彼此路徑

- 咖啡的流體動力學和船周圍的泡沫

If you think OpenAI Sora is a creative toy like DALLE, ... think again. Sora is a data-driven physics engine. It is a simulation of many worlds, real or fantastical. The simulator learns intricate rendering, "intuitive" physics, long-horizon reasoning, and semantic grounding, all… pic.twitter.com/pRuiXhUqYR

— Jim Fan (@DrJimFan) February 15, 2024

重點二:可以依照時間上向前或向後擴展影片

Sora 還能夠在時間上向前或向後擴展影片,這是什麼意思呢?

可以參考官方的影片,Sora可以為原本的影片生成額外的內容,進而增強敘事或視覺故事線,未來可以有更多創意發想的來源了!

重點三:可以把 DALL·E 的圖片變成動畫

除了可以用文字指令生成影片外,Sora 還可以用以圖片、影片當作指令。

舉例來說,下面左圖是一個平面設計風格的怪物插圖,透過 Sora 轉化後可以變成動畫,如右圖一般。

看起來真厲害!我光看這些範例都捏了一把冷汗 XD

跟其他 AI 影片生成 有什麼不一樣?跟Runway, Pika 差異在哪?

接續著剛剛上面的把圖片生成動畫,現在也有很多 AI 生成工具可以做到,像是 Runway 和 Pika。這兩個工具我之前也有多少碰過,在此跟大家分享他們差異在哪:

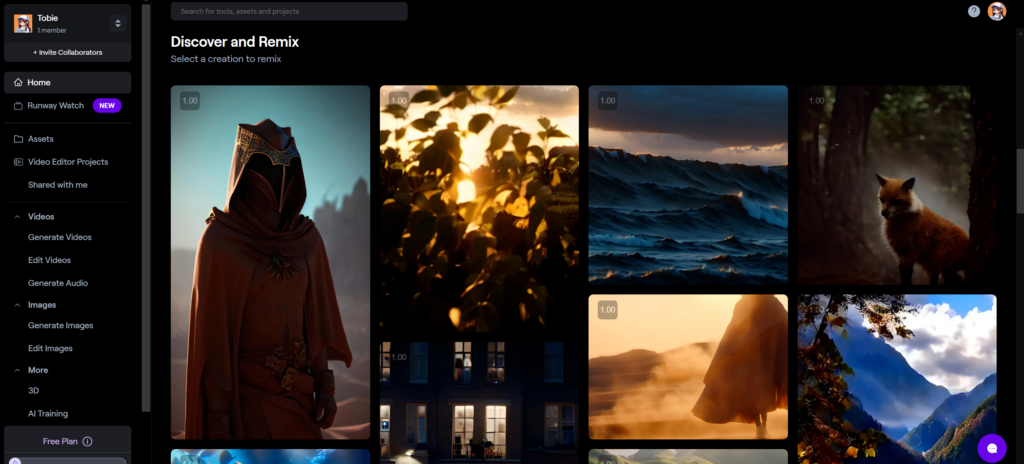

Runway

Runway 是在2018 年推出,透過第二代更新,Runway 引入了導演模式和自訂攝影機控制,提供對攝影機移動、縮放等級和運動組合更精細的控制。

它支援高達 4K 的高解析度視訊匯出,最多可以支持18秒。

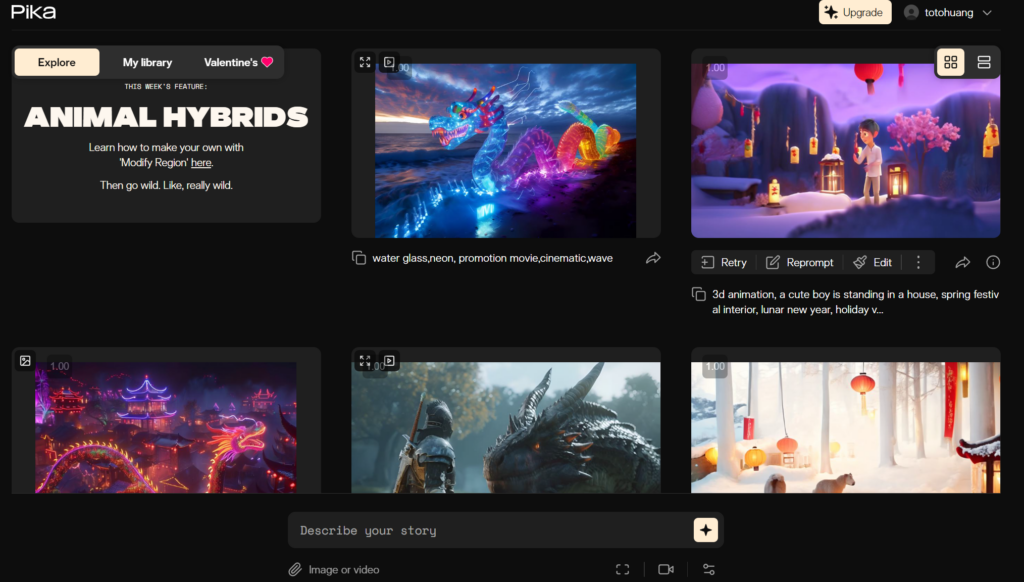

Pika

主要通過Discord操作,他影片產生的電影效果有名,很多人都用它拿來做“假電影預告片”。相較Runway,Pika 更專注於捕捉細膩的人類動作和情感,但比較沒有精密的相機和動作控制,一次只能生出 3 秒。

Sora 哪裡不一樣?

根據以上,你可以看到只要透過簡單的文字指令、圖片指令就可以創造現實且富有想像力的場景。

他的能力甚至遠遠超過其競爭對手。

Sora 不只可以生成長達 60 秒的影片,他甚至具備複雜的攝影機角度,也可以細部描繪人類的動作和情感,不禁讓我們思考,他真的是產業遊戲規則的重大革命啊。

Sora 開放了嗎?現在誰可以用?

Sora 開發尚未完成,現在只開放給一些人使用,像是視覺設計、藝術者,或是電影製作者試用,並從他們那邊獲取有幫助的使用反饋。

現在尚未全面開放給一般民眾使用,大家可以再等等囉!

使用 Sora 做的影片會侵權嗎?

你可能會擔憂:Sora製作的影片內容是否會侵權?

研究員Peeble表示目前 Sora 的訓練資料都是來自他們已授權的內容以及公開的內容。

不過未來等到開放,使用者拿其他動畫師的影片下指令請Sora做出的影片,這類型的內容可能要等到以後上市才會有更嚴格的規範。

未來 Sora 還會怎麼改善呢?

根據 OpenAI 官方表示,他們現在也正在跟紅隊成員(red teamer)合作,測試是否有錯誤訊息、仇恨內容以及偏見等等內容,進而了解Sora 模型的缺陷。

什麼是 Red teamer 紅隊成員 ?

紅隊成員簡單來說是網路安全專業人員,會透過攻擊和破壞這些相同的框架來幫助公司改進 IT 安全框架。更多詳細內容可以參考:What is a red teamer? All you need to know

另外, OpenAI 內部也在著手建立偵測分類器,幫助判斷是否為 Sora 所生成的影片。以及也會透過文字偵測器,檢查使用者的文字輸入指令是否都有符合規定,像是暴力、性內容、仇恨圖像、名人肖像或他人智慧財產權的文字輸入指令都會被拒絕。

未來如果 OpenAI 打算將 Sora 導入他們其他模型中,也會規畫將詮釋資料 C2PA Metadata 加入影片中,幫助大家能夠更方便驗證來源和相關資訊。

------------

看完以上的資訊,我到現在都還在消化 XD

文章最後再放上幾個 Twitter上大家生成的影片,讓人真的覺得又興奮又緊張呀!

我有料想到這個 AI 生成影片的世界會來臨,但沒想到這麼快哈哈!

就讓我們繼續期待未來Sora開放的那時候吧~

Introducing Sora, our text-to-video model.

— OpenAI (@OpenAI) February 15, 2024

Sora can create videos of up to 60 seconds featuring highly detailed scenes, complex camera motion, and multiple characters with vibrant emotions. https://t.co/7j2JN27M3W

Prompt: “Beautiful, snowy… pic.twitter.com/ruTEWn87vf

Just enhancing some of OpenAI's Sora generations with some AI music from Splash 😉 pic.twitter.com/spqlmHxkVt

— AmliArt (@amli_art) February 15, 2024

If you're not paying attention to OpenAI's Sora, you're making a big mistake (https://t.co/9znskh7FzX).

— griff (@griffinbeels) February 15, 2024

Whether you like it or not, when fully released, it WILL revolutionize filmmaking and content creation.

Let me tell you why these examples are groundbreaking: pic.twitter.com/GZPzfVXuK7

https://t.co/uCuhUPv51N pic.twitter.com/nej4TIwgaP

— Sam Altman (@sama) February 15, 2024

https://t.co/rmk9zI0oqO pic.twitter.com/WanFKOzdIw

— Sam Altman (@sama) February 15, 2024

你可能對這些文章有興趣...

ChatGPT 的 GPTs 是什麼? GPTs 建置、實際功能與流程圖解教學一看就懂